Com isso em mente, o Google está lançando uma nova atualização que conta com respostas inteligentes de sua assistente pessoal, focadas em educar e principalmente sinalizar que tal comportamento errôneo não deve ser utilizado com inteligência artificiais ou na vida real. A novidade é semelhante à atualização da BIA, do Bradesco, que passou a responder aos ataques misóginos e com demais ofensas. Veja todos os detalhes agora mesmo.

Atualização está sendo preparada desde 2020

Com o nome de #NãoFaleAssimComigo, o Google começou a preparar as novas respostas quando recebeu o relatório I’d Blush if I Could da UNESCO que foi lançado em 2019 e sinalizou que o uso de vozes com entonação feminina estava ajudando a perpetuar preconceitos de gênero. Arpita Kumar, que é estrategista Sênior de Conteúdo do Time de Personalidade do Google Assistente, começou a trabalhar na ideia que foi lançada hoje (03), mas pode ser considerada uma atualização contínua. Até porque, novos termos estão considerados e mais utilizados como ofensas todos os dias. Durante o evento de anúncio de novas respostas do Google Assistente, Arpita ressaltou que todo o trabalho ainda é feito de forma manual, mas com o passar do tempo, o desenvolvimento de um algoritmo apenas para cadastrar novos termos e respostas adequadas pode ser realizado. Antes de serem lançadas para todos os usuários, pequenos testes foram realizados com uma pequena parcela de público e surpreendentemente, houve uma crescimento de 6% nas tréplicas para as assistente pessoais. Ao receberem respostas que não eram esperadas, as pessoas que participaram da análises começaram a pedir desculpas ou até mesmo questionar porque tal comportamento não deveria ser utilizado.

Como os comandos abusivos foram identificados?

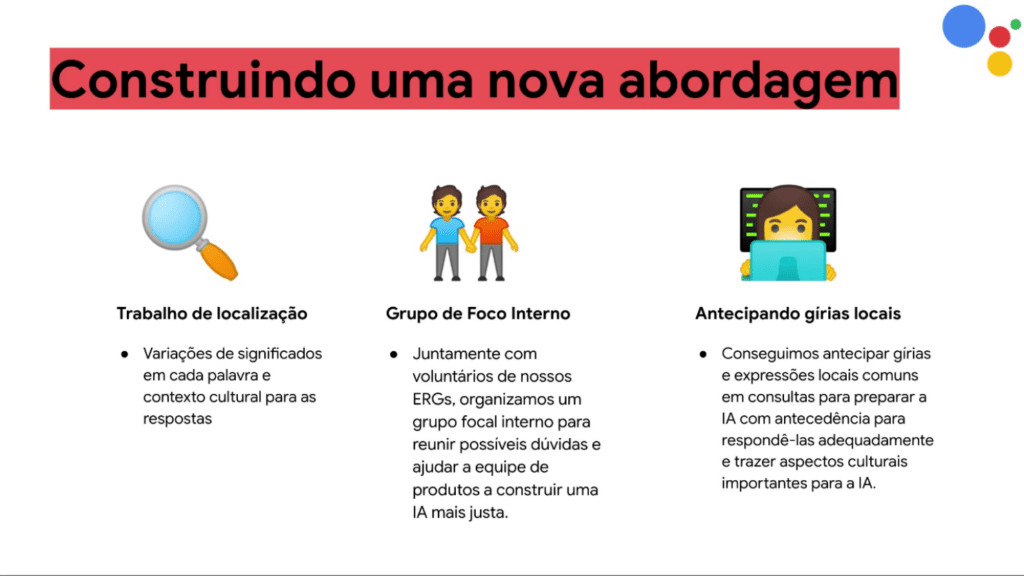

O Google Assistente está disponível em 95 países e consegue enviar e entender comandos em 29 idiomas diferentes, o que permite que a empresa desenvolvedora tenha acesso a uma grande parcela de comandos que poderiam ser evitados. Arpita compartilhou que o processo de identificação começou pela filtragem do que era dito pelos usuários, para que em segundo plano, a revisão fosse feita. A criação das novas respostas aconteceu logo em seguida. Livros, artigos e demais conteúdos criados por mulheres foram utilizados como base para a criação de respostas, já que a nível mundial, as assistentes pessoais do Google com entonação considerada feminina estavam sofrendo mais ataques. Isso não significa que a voz laranja do Google Assistente (com entonação masculina) não estava sendo atacada. Usuários estavam a desculpa de que “não é uma pessoa de verdade” para falar comandos com tons homofóbicos, sendo uma a cada dez ofensas registradas. A voz laranja foi lançada durante o ano passado e já está recebendo ataques que podem facilmente ser reproduzidos na vida real.

Quais as novas respostas?

Quando um comando considerado ofensivo for identificado pelo sistema, uma resposta especial será enviada pela voz, ao invés de tudo ser levado com humor ou o direcionamento para buscas na internet. Dessa forma: Além de desconversar, o Google Assistente estará educando seus usuários para que o mesmo comportamento não seja levado para a “vida real”. A empresa não irá banir usuários que tiverem uma abordagem inadequada, mas tentará mudar a forma como pensam para que pessoas próximas não sofram os mesmos ataques. Confira outro exemplo:

Google Assistente no Brasil

O Brasil é um dos países que mais utilizam o Google Assistente e no ranking mundial, estamos na terceira posição da lista de nações com mais usuários ativos. Com a chegada da pandemia de COVID-19, o uso aumentou e a empresa decidiu que os brasileiros serão um dos primeiros a receberem as novidades. O português é uma língua com diversas variações e para que as novas respostas estivessem disponíveis, o time internacional colaborou com especialistas brasileiros. De acordo com Maia Mau, Head de Marketing do Google Assistente para a América Latina, foram inseridos 200 termos que são considerados comandos abusivos e devem receber respostas especiais. Ainda sobre os dados no Brasil, 2% das interações com o Google Assistente são abusivas e 15% destas possuem termos misóginos com até mesmo com assédio sexual. Todos os dias, mulheres sofrem em diversas situações, então o Google, por meio destas mudanças, deseja mudar o pensamento de seus usuários. Colocando isso em números: 22% dos ataques para a voz vermelha possuem alguma fala misógina e 13% dos comentários direcionados para a voz laranja são sobre aparência física (destes, 2% envolvem misoginia). A assistente pessoal deixou de usar o “por favor” ao pedir respeito, pois a equipe entendeu que o respeito não deve ser solicitado com educação. A frase “Não fale assim comigo” é mais ideal para educar e indicar que tal comportamento não deveria nem mesmo ser direcionado para uma assistente pessoal ou pessoa na vida real. As novas respostas estão disponíveis a partir de hoje (03) para todos os usuários e a atualização será contínua, assim que novos comandos abusivos começarem a serem mais ditos para a Google Assistente. O que você achou da atualização? Diga pra gente nos comentários!

Veja também

Confira as novidades da Busca do Google para eleições de 2022. Fonte: Google